취미가 좋다

PubLayNet : Largest Dataset Ever for Document Layout Analysis 본문

PubLayNet : Largest Dataset Ever for Document Layout Analysis

XuZhong, Jianbin Tang, Antonio Jimeno Yepes

Overview

PubLayNet은 document layout analysis를 위한 데이터셋이다.

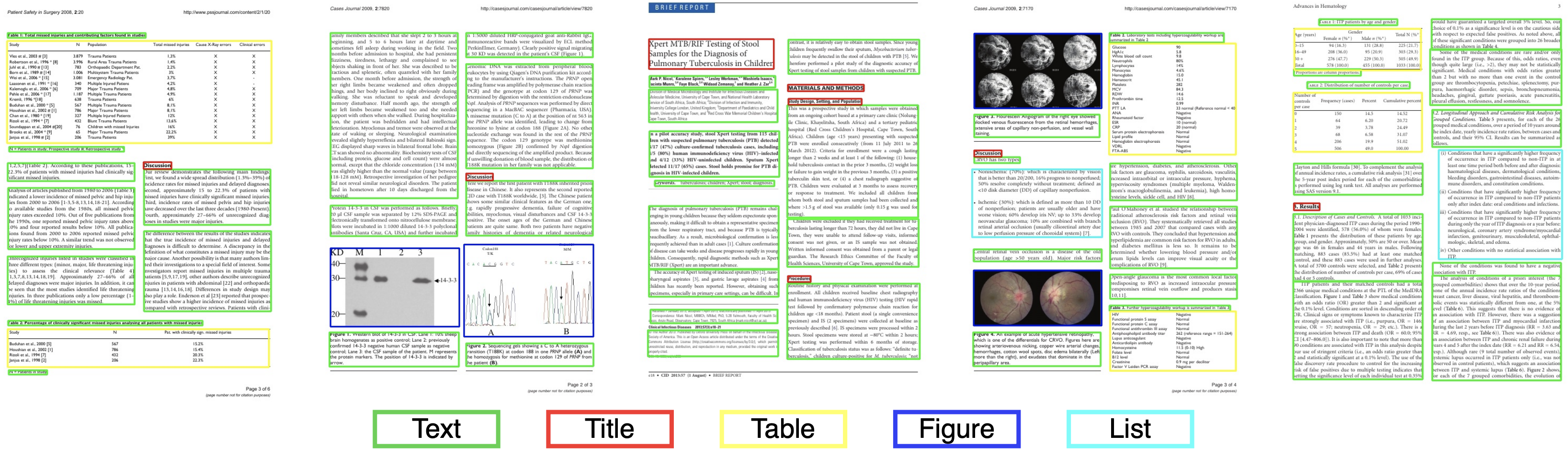

문서 이미지와 text, list, figure와 같은 다양한 annotation이 포함된다.

여러 layout들은 bounding box와 polygonal segmentation 형태로 저장되어 있다.

데이터셋은 XML representation과 의학 분야의 백만 개의 PDF article을 자동 매칭하여 만들어졌다.

Abstract

구조화되지 않은 디지털 문서의 layout을 인식하는 것은, 문서를 구조화하여 기계가 읽을 수 있도록 parsing 할 때 매우 중요한 단계이다.

컴퓨터 비전을 위해 발전된 DNN(Deep Neural Network)는 문서 이미지의 layout을 분석하는 데 효과적인 방법이라고 증명되어 왔다.

그러나 현재 공개된 문서 layout 데이터셋은 컴퓨터 비전 데이터셋보다 그 양이 좀 적다.

그래서 모델은 컴퓨터 비전 데이터셋으로 pre-trained 된 베이스 모델을 transfer learning 하여 학습된다.

PubLayNet 데이터셋은 PubMed Central(의학 분야 문서)의 백만 개 PDF 문서와 XML 표현을 자동으로 매칭시킨 문서 layout 분석을 위한 데이터셋이다.

데이터셋의 크기는 컴퓨터 비전의 데이터셋과 비슷하다.

한 실험은 PubLayNet으로 학습된 DNN이 과학 문서의 layout을 정확하게 인식하는 것을 보여준다.

pre-trained된 모델은 다른 문서 도메인으로 transfer learning 하는데 효과적이다.

아래와 같은 모습으로 주석이 달려있다.

layout의 카테고리는 아래와 같다.

PubLayNet

PubLayNet is a large dataset of document images from PubMed Central Open Access Subset. Each document’s layout is annotated with…

developer.ibm.com

PubLayNet: largest dataset ever for document layout analysis

Recognizing the layout of unstructured digital documents is an important step when parsing the documents into structured machine-readable format for downstream applications. Deep neural networks that are developed for computer vision have been proven to be

arxiv.org

ibm-aur-nlp/PubLayNet

Contribute to ibm-aur-nlp/PubLayNet development by creating an account on GitHub.

github.com

'Dataset' 카테고리의 다른 글

| FUNSD : A Dataset for Form Understanding in Noisy Scanned Documents (0) | 2021.02.13 |

|---|---|

| CORD (Consolidated Receipt Dataset) (0) | 2021.02.13 |